|

892| 4

|

[试用测评] 【花雕动手做】AI 视觉二哈识图 2 之姿态识别人体姿态图 |

|

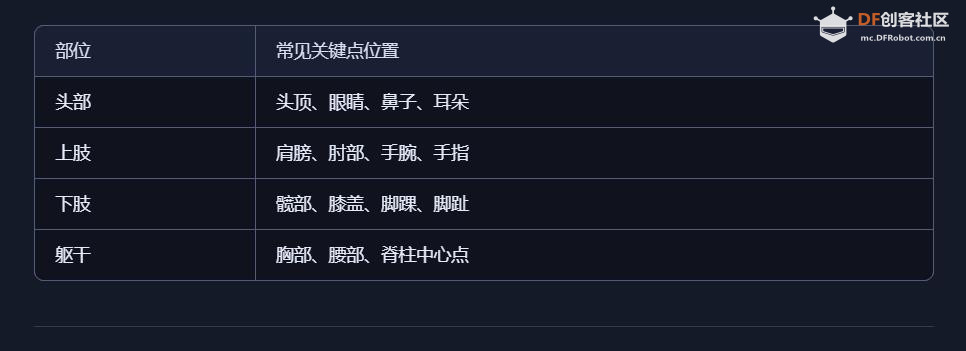

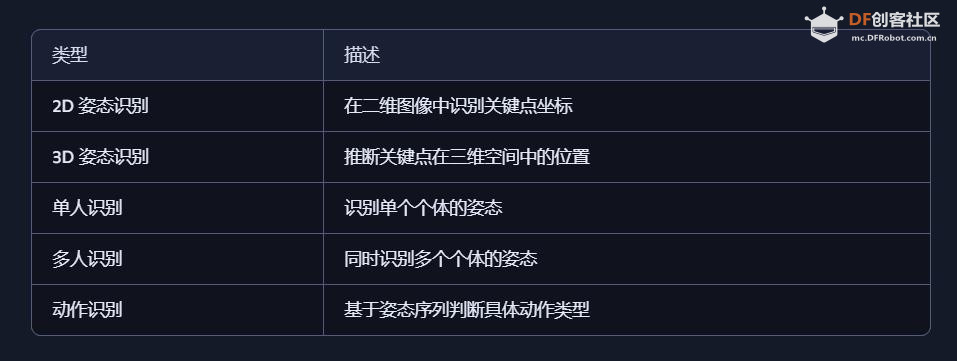

姿态识别(Pose Estimation)是一种计算机视觉技术,其核心目标是:通过摄像头或图像分析系统,自动检测人体或物体的关键点位置,并判断其空间姿态、动作或结构状态。姿态识别是让机器“理解动作语言”的关键技术。它让设备“看懂动作”,广泛应用于智能健身、动作分析、人机交互、机器人控制、AR/VR等领域。 1、姿态识别的基本定义 姿态识别是指: 识别图像或视频中人体(或物体)的关键点位置,如关节、骨骼、角度等,并推断其动作或姿态。 它不仅识别“是谁”,更关注“在做什么”。 2、人体姿态识别的关键点示例  3、姿态识别的技术流程 图像采集:通过摄像头或视频获取动作画面。 目标检测:识别画面中的人体或物体区域。 关键点定位:标出各个关节或结构点的位置坐标。 姿态建模:根据关键点关系构建骨架或动作模型。 动作分析:判断当前姿态属于哪种动作或状态。 4、应用场景举例 智能健身:识别用户动作是否标准,提供纠正建议 游戏互动:通过身体动作控制角色或界面 教育实验:识别学生手势、站姿、运动状态 行为分析:识别走路、跑步、跌倒等行为 机器人控制:通过人类姿态指令控制机器人动作 AR/VR:实现沉浸式体感交互体验 5、姿态识别的类型  |

沪公网安备31011502402448

沪公网安备31011502402448© 2013-2026 Comsenz Inc. Powered by Discuz! X3.4 Licensed