|

2026| 4

|

[试用测评] 【花雕动手做】AI 视觉传感器二哈识图2之识别文字数据 |

|

一、相关知识点 1、HUSKYLENS 2(二哈识图2)是DFRobot推出的新一代AI视觉传感器,搭载6TOPS算力的Kendryte K230双核RISC-V芯片,集成1GB LPDDR4内存与8GB存储,支持人脸识别、物体检测、姿态估计等20余种预置AI模型,同时允许用户通过自训练模型部署实现定制化识别 。其硬件配置包括200万像素摄像头、2.4英寸触摸屏、可更换镜头模组(支持显微/夜视)及RGB补光灯,搭配UART/I2C接口可无缝连接Arduino、树莓派等开发板,实现实时图传与多模态交互。内置MCP服务打通本地视觉与大模型能力,例如识别午餐图片后可生成膳食建议,而模型广场提供车牌识别、跌倒检测等垂直领域即用型方案。作为教育利器,它已融入《中小学人工智能通识教育指南》课程体系,通过Mind+图形化编程工具降低AI开发门槛,助力创客教育与STEAM实践。  2、行空板 K10 是一款专为中小学信息科技教学和创客项目设计的国产 AIoT 开发板,以 ESP32-S3 为核心,高度集成 2.8 英寸全彩 LCD 屏、摄像头、双麦扬声器、WiFi 蓝牙模块及温湿度、光线、加速度等多种传感器,无需额外配件即可实现离线语音识别(支持 200 词库)、人脸识别、二维码读取、物联网联动等功能,支持 Mind + 图形化编程与 MicroPython 代码编程,兼顾入门便捷性与功能扩展性,丰富的扩展接口还能连接外部传感器、执行器,轻松落地 AI、物联网类创意项目,是编程学习与科创实践的高性价比选择。  3、Mind + 是 DFRobot 旗下蘑菇云科创教育团队研发的、拥有自主知识产权的国产青少年编程软件,它兼容 Scratch3.0,既支持零基础学习者拖拽图形化积木编程,也能切换至 Python/C/C++ 代码编程,且积木可自动转换为对应代码助力进阶学习,同时适配行空板M10\ K10、Arduino、micro:bit 等众多主流开源硬件与上百种电子模块,集成图像识别、语音识别等 AI 功能及物联网开发能力,还搭配实时交互、程序烧录脱机运行等模式与丰富教学案例,适配校内外编程教学、创客项目及竞赛等场景,是兼顾低入门门槛与高拓展性的科创教育工具。 二、硬件连接 准备材料 行空板K10 x 1 HUSKYLENS 2 x 1 USB数据线 x 2 4pin连接线(或杜邦线)x 1 准备一根USB数据线和一根4Pin白色硅胶线。使用USB数据线连接电脑与行空板K10,使用4Pin黑胶先连接行空板K10与HuskyLens 2,再使用额外的USB数据线n连接示意图如下连接HUSKYLENS 2的Type-C接口与电源,为HUSKYLENS 2进行额外供电。接线图可参考下图。    |

|

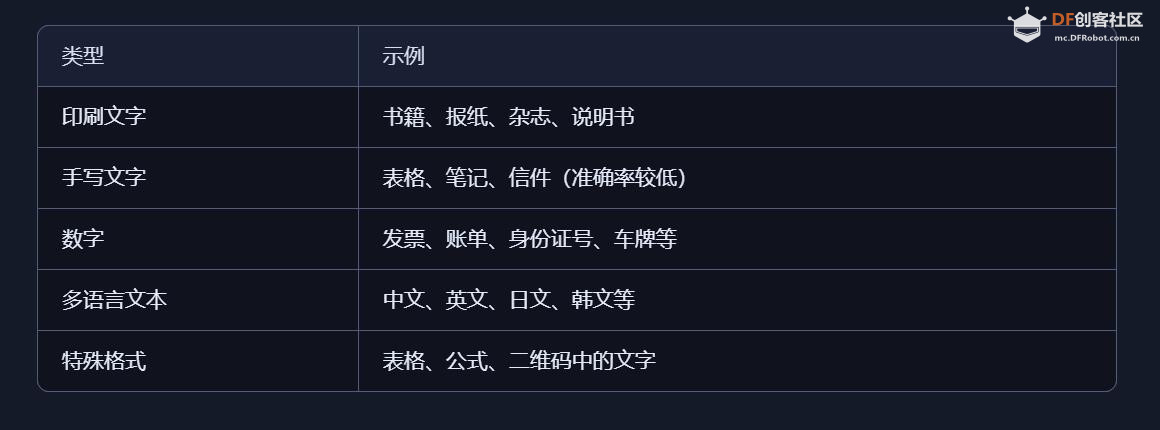

三、光学字符识别(Optical Character Recognition,简称 OCR)是一种图像识别技术,其核心目标是:将印刷或手写文本从图像、扫描件或照片中提取出来,并转换为可编辑的数字文本。光学字符识别是人工智能与图像处理的经典应用之一。它让计算机“看懂文字”,是连接纸质信息与数字世界的关键桥梁。 1、OCR 的基本原理 OCR 的识别过程通常包括以下几个步骤: 图像采集:通过扫描仪、摄像头或文件获取含有文字的图像。 图像预处理:去除噪声、校正倾斜、增强对比度,提高识别准确率。 文字定位:识别图像中哪些区域包含文字。 字分割:将整段文字拆分为单个字符。 字符识别:通过模式匹配或深度学习模型识别每个字符。 文本输出:将识别结果转换为可编辑的文本格式,如 TXT、DOC、PDF。 2、OCR 能识别哪些内容?     |

|

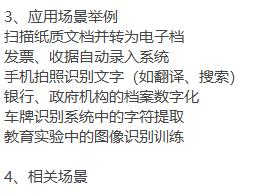

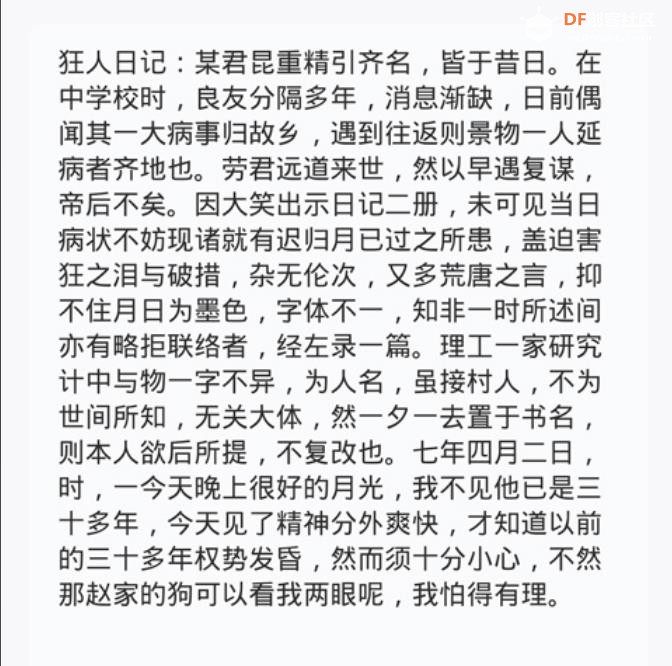

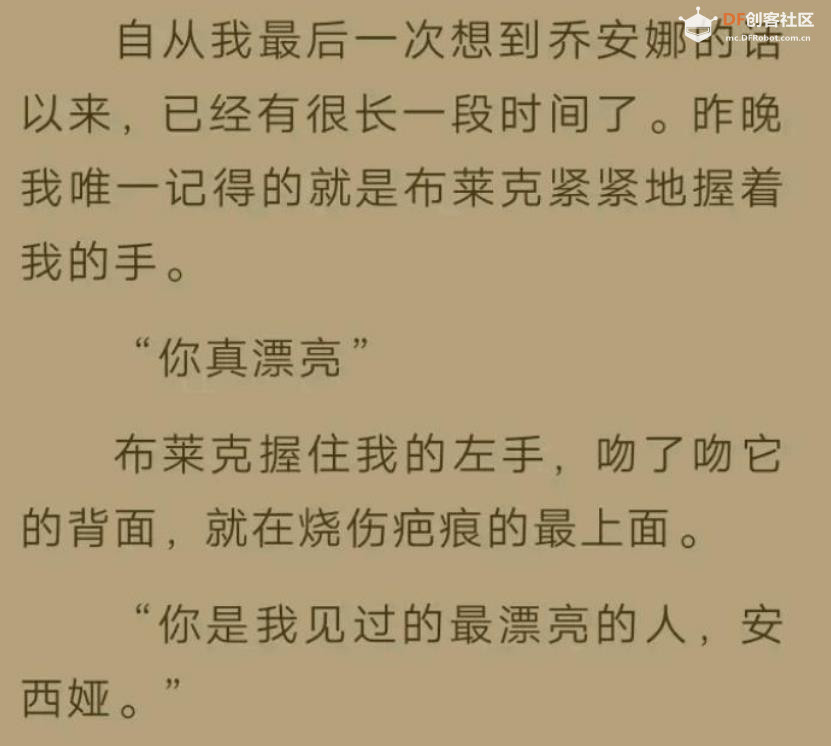

四、在光学字符识别功能下,HUSKYLENS 2 可识别并框出视野内文字块出现的区域,并将识别到的文字显示在屏幕上,可使用以下示例程序,统计画面中可识别文字块的总数、获取画面中离十字光标最近的文字块相关数据,可以读取的数据有:文字块的ID 、名称、内容、中心点X坐标和Y坐标、文字块宽度和高度。 1、实际测试的几个范本     2、测试实验代码 |

|

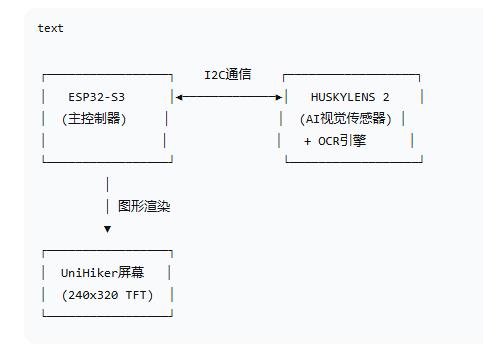

本帖最后由 驴友花雕 于 2025-11-20 17:32 编辑 3、代码解读: 系统架构与核心技术栈 1. 硬件系统架构  2. OCR技术实现层次 text 应用层: 文字识别结果显示系统 ↓ 算法层: HUSKYLENS固件(集成OCR引擎) ↓ ├── 文本检测(CTPN/EAST) 驱动层: I2C通信协议 + 屏幕驱动 ├── 文字识别(CRNN/Attention) ↓ └── 文本后处理 硬件层: 摄像头 + AI芯片 + 显示屏 代码执行流程深度分析 1. 初始化阶段技术细节 cpp 关键技术点: 硬件抽象层:通过对象封装底层硬件操作细节 通信可靠性:I2C连接的重试机制确保系统稳定性 显示优化:双缓冲技术避免屏幕撕裂 2. 主循环实时处理流水线 cpp OCR数据结构与信息提取 1. HUSKYLENS返回的数据结构 cpp 2. 信息提取宏分析 cpp 显示系统架构分析 1. 信息可视化设计 text 行1: [系统标题] - 蓝色,固定标识 行2: (保留行) 行3: [中心文字块ID] - 红色,目标标识 行4: [文字块总数] - 红色,环境感知 行5-6: [文字内容] - 红色,核心识别结果 行7-8: [文字块尺寸] - 红色,空间信息 行9-10: [文字块坐标] - 红色,定位信息 2. 颜色编码策略 0xFF0000 (红色):全部信息使用红色,突出显示重要性 0x0000FF (蓝色):仅标题使用蓝色,建立视觉层次 设计考量:在文字识别场景中,所有识别信息都具有高重要性,因此统一使用红色强调。 实时性能与优化策略 1. 时序控制分析 cpp OCR处理时间:约30-40ms(包含图像采集、预处理、识别) 显示渲染时间:约5-8ms(文本渲染和缓冲区交换) 系统余量:2-5ms(处理波动和通信延迟) 2. 数据处理优化 cpp OCR技术特性分析 1. 文字识别技术栈 HUSKYLENS OCR可能采用的流程: text 图像输入 → 文本检测(找出文字区域) → 文本识别(字符级分类) → 后处理 ↓ ↓ ↓ ↓ RGB图像 bounding box 字符序列 语言模型校验 2. 识别能力特性 多语言支持:可能支持中文、英文、数字混合识别 字体适应性:对印刷体、手写体有一定适应能力 光照鲁棒性:内置图像预处理增强不同光照条件下的识别率 多文本块处理:能够同时识别画面中的多个文字区域 |

沪公网安备31011502402448

沪公网安备31011502402448© 2013-2026 Comsenz Inc. Powered by Discuz! X3.4 Licensed